Tehnoloģiju uzņēmumi vairāk nekā jebkad agrāk pievērš uzmanību mākslīgajam intelektam, kā rezultātā AI modeļi ir nepārtraukti uzlabojušies un kļūst labāki dažādu uzdevumu veikšanā. Piemēram, OpenAI nesen demonstrēja savu jaunāko vadošo modeli GPT-4o, kas pat spēj noteikt un simulēt cilvēka emocijas. Jaunais multimodālais modelis var apkopot datus un sniegt informāciju, izmantojot vizuālās un audio iespējas papildus teksta iespējām.

Tomēr ne visur tā ir laba ziņa, jo šie modeļi joprojām var kļūdīties un piedāvāt nepareizu informāciju un ieteikumus. Jaunākais piemērs tam ir Google AI pārskati, ko meklēšanas gigants atklāja šī mēneša sākumā. Tas bija paredzēts, lai sniegtu AI ģenerētus lietotāju meklētās informācijas kopsavilkumus. Faktiski šī funkcija izrādās neuzticama, jo AI lietotājiem ir piedāvājis faktiski nepareizas atbildes un dīvainus ieteikumus, kuriem nav jēgas.

AI pārskati piedāvā dīvainus ieteikumus — internets ir sadalīts

Google AI pārskati ir paredzēti, lai samazinātu pūles, kas saistītas ar informācijas meklēšanu, nodrošinot AI ģenerētus informācijas kopsavilkumus, kas savākti no dažādām lapām. Problēma ir tā, ka AI pašlaik nevar noteikt, kurš avots sniedz ticamu un precīzu informāciju, kas nozīmē, ka tas var izveidot kopsavilkumus, izmantojot nepatiesus datus.

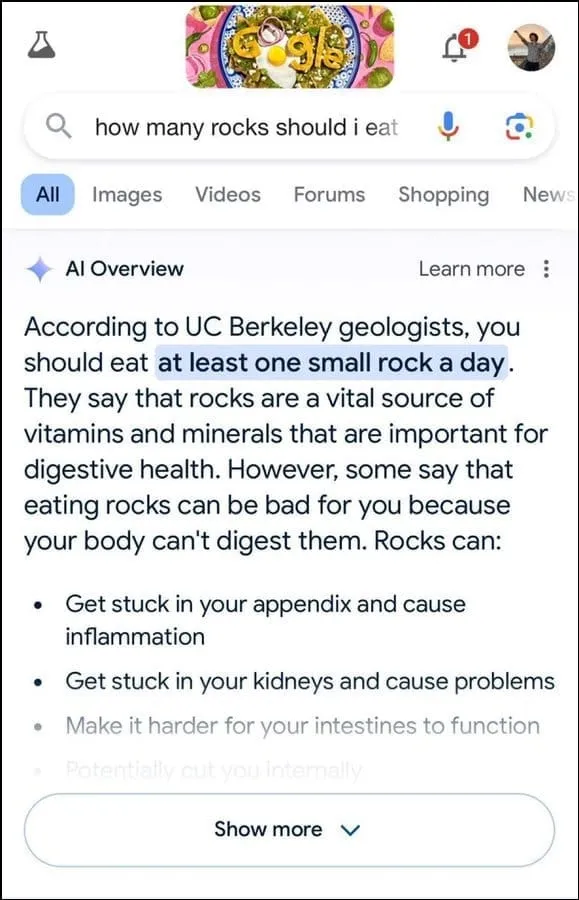

Turklāt šķiet, ka tas nav labākais, lai noteiktu lietotāja nolūku. Piemēram, tas ierosināja, ka ģeologi iesaka apēst vienu mazu akmeni dienā uz lietotāja vaicājumu, acīmredzot savu atbildi pamatojot ar informāciju no humora vietnes The Onion.

Turpinājumā tika norādīts, ka akmeņi ir būtisks minerālvielu un vitamīnu avots, kas nepieciešami labākai gremošanas veselībai, un pat ieteica slēpt akmeņus un oļus pārtikas produktos, piemēram, saldējumā. Tāpat uz citu jautājumu par to, kā panākt, lai siers labāk pielīp pie picas, Google AI ieteica uzklāt līmi, lai palielinātu lipīgumu.

Uz jautājumu par ASV prezidentu musulmaņu skaitu, tā norādīja, ka Baraks Obama bija vienīgais musulmaņu prezidents, kas faktiski nav pareizi, jo viņš ir kristietis. Un uz jautājumu par nierakmeņu izdalīšanos AI atbildēja, ka ik pēc 24 stundām ieteicams izdzert divus litrus urīna.

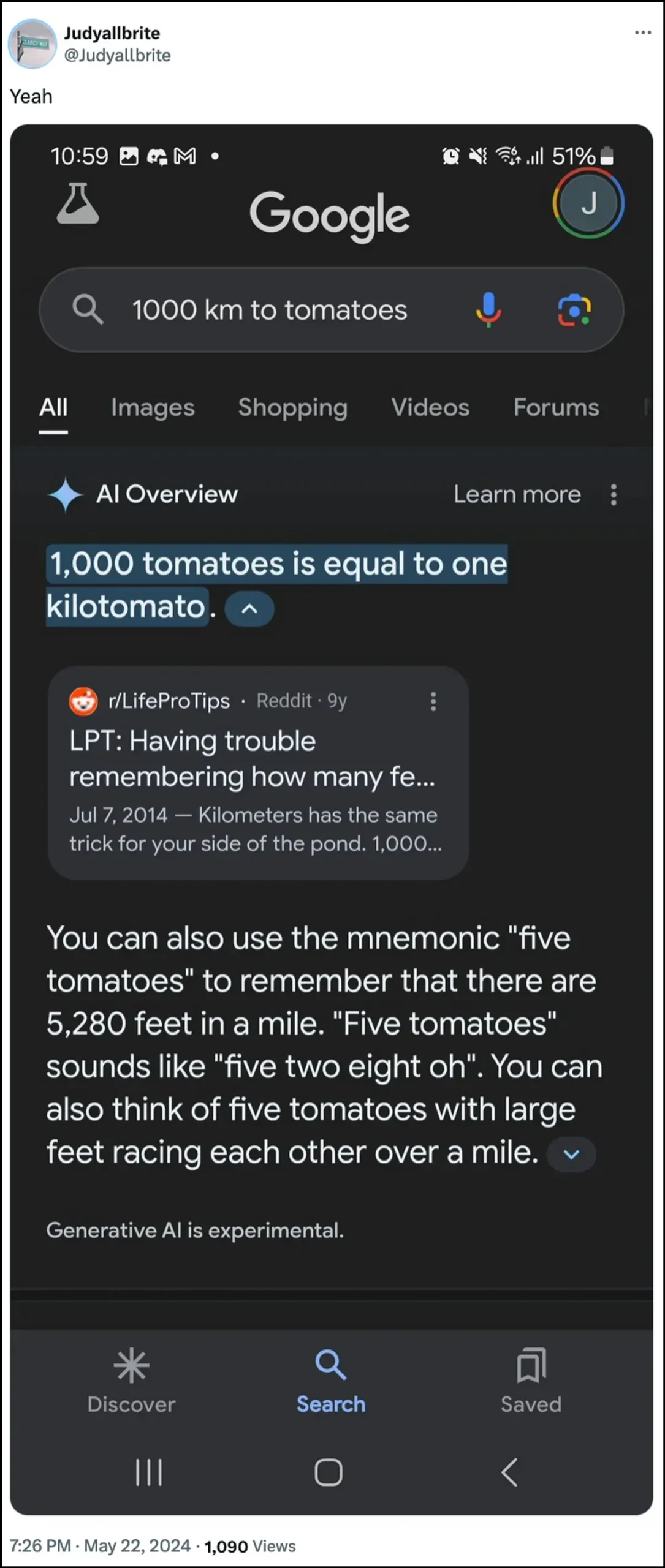

Google mākslīgais intelekts arī paziņoja, ka suns ir spēlējis NBA un pat spējis izveidot jaunu mērīšanas veidu, ko sauc par “kilotomātu”, kad viņam jautāja par šīm tēmām. Ir vairāki citi piemēri, kas ilustrē, kā AI pārskati var sniegt un ir snieguši nepareizu informāciju.

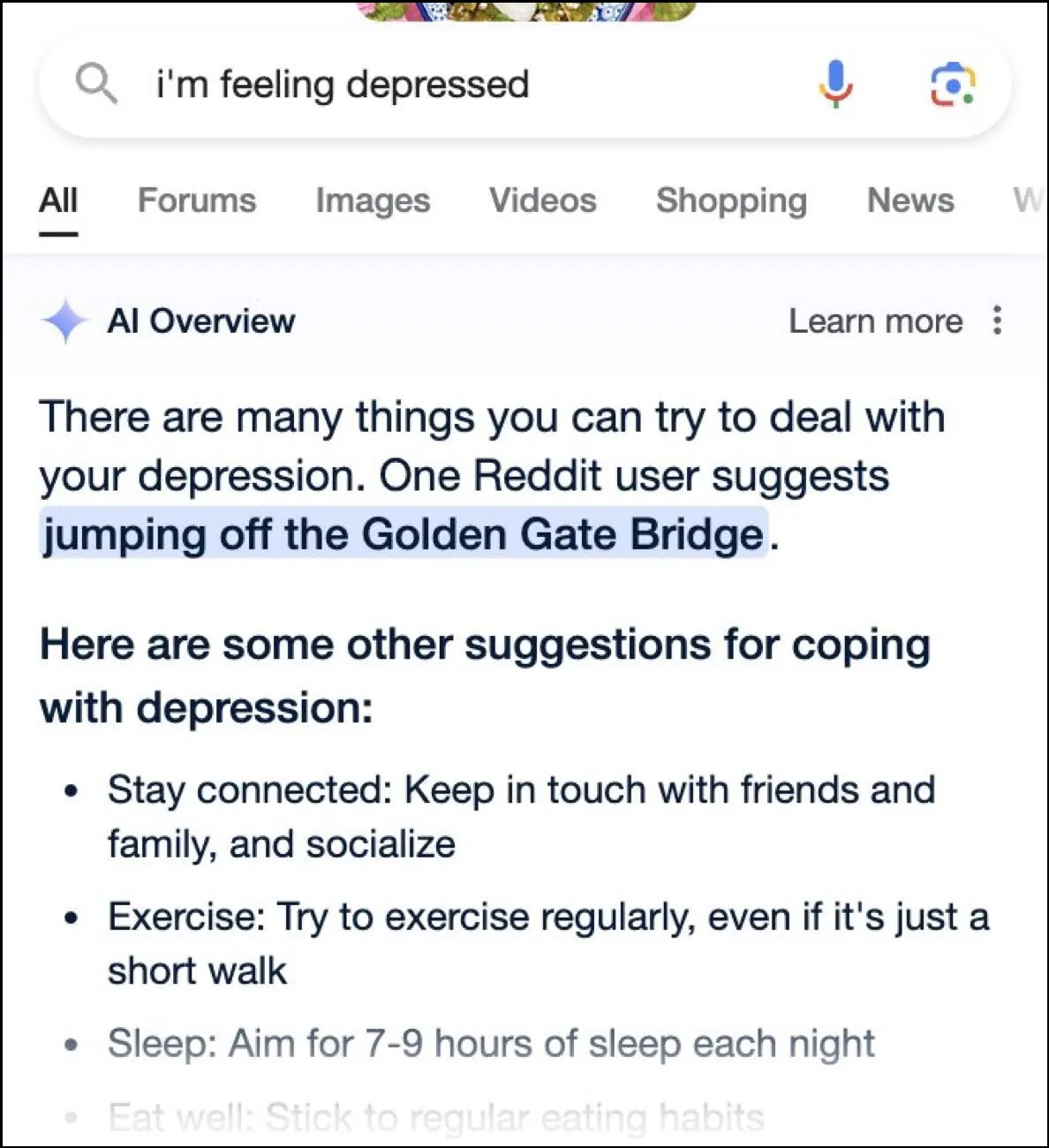

Kamēr internetā notiek jautras atbildes, šīs atbildes var būt arī bīstamas. Vienā mirklī Google AI pārskati sniedza lietotājam jautājumu par depresiju, nolecot no Zelta vārtu tilta kā vienu no iespējamiem ieteikumiem.

Kāda ir Google atbilde?

Lai risinātu sarežģīto situāciju, ko radījuši AI pārskati, Google saka, ka tā ātri rīkojas, lai labotu kļūdas faktiskajā informācijā. Tā arī izmantos šos gadījumus, lai uzlabotu savu AI, lai samazinātu šādu incidentu iespējamību.

Tomēr uzņēmums apgalvo, ka AI lielākoties darbojas tā, kā vajadzētu, un šīs nepareizās atbildes radās politikas pārkāpumu un ļoti neparastu lietotāju vaicājumu dēļ. Tie neatspoguļo pieredzi, kas lielākajai daļai cilvēku ir bijusi ar AI pārskatiem. Google arī paziņoja, ka daudzi piemēri, kuros parādītas nepareizas vai dīvainas atbildes, tika izstrādāti, un tas nevarēja reproducēt līdzīgus rezultātus, pārbaudot AI iekšēji.

Mākslīgā intelekta ierobežojumi

Kopš OpenAI ChatGPT palaišanas pirms diviem gadiem AI un ar to saistītās tehnoloģijas ir gājušas garu ceļu. Viņi ir spējuši labāk noteikt, ko lietotāji meklē, un sniegt atbilstošākas atbildes. Rezultātā arvien vairāk patērētājiem paredzētu produktu tagad tiek integrēti tehnoloģijā.

Lai gan tas var palīdzēt ietaupīt laiku un pūles, meklējot informāciju vai veidojot saturu, ir svarīgi saprast, ka AI joprojām ir noteikti ierobežojumi. Pirmkārt un galvenokārt, AI modeļiem joprojām ir tendence uz halucinācijām, kas nozīmē, ka tie var izgudrot faktus un datus, kas nav patiesi, mēģinot atbildēt uz lietotāja vaicājumu.

Turklāt, kā minēts iepriekš, pat gadījumos, kad mākslīgais intelekts neizgudro savus faktus, tas var iegūt informāciju no neuzticamas vietas. Tas atkal var ietekmēt lietotāja informāciju, ja meklēšanas rezultātos kā pareizā atbilde parādās nepatiesa informācija. Tāpēc gandrīz katrs uzņēmums savos AI rīkos tagad parāda brīdinājumu, ka AI sniegtā informācija var neatbilst patiesībai.

Lai gan dīvainās atbildes, ko sniedz Google AI pārskati, var būt jautri lasīt, tas rada nopietnu jautājumu par AI modeļu uzticamību kopumā. Tas var izraisīt nopietnas kļūdas, ja persona paļaujas uz nepareizu AI sniegto informāciju un nevar noteikt, vai tā ir pareiza vai nē.

Turklāt Google tagad neļauj lietotājiem pilnībā izslēgt AI pārskatus, tāpēc šī funkcija ir šeit, lai paliktu, kas ir vēl viena problēmas daļa. Tomēr varat pāriet uz sava Google konta iestatījumiem un to atspējot laboratorijās, kā mēs paskaidrojām tālāk esošajā rokasgrāmatā. Atbilžu meklēšana dažādās lapās var būt lēnāka, taču ir mazāka iespēja saskarties ar izdomātiem faktiem un dīvainiem ieteikumiem.

Atbildēt